【AIPC自作】i9-9900Kは限界?最新AI「Gemma 4」を快適に動かすための段階的アップグレード術

こんにちは、トシミズです。

これまで自作PCの世界では、「いかに高画質でゲームを動かすか」がハイエンドの証でした。しかし、2026年現在、その常識が根底から覆されようとしています。

主役はゲームではなく、「AI(人工知能)」。

Googleから発表された最新のオープンモデル「Gemma 4」を、いかにストレスなく、ローカル環境で動かすか。これが新しい自作の醍醐味になってきました。

今回は、長年連れ添った愛機「Core i9-9900K」の限界を見つめつつ、AIPCへと進化させるための現実的なロードマップを考えてみます。

1. 現状診断:わが家の「9900K + RTX 2080S」は現役か?

まずは厳しい現実から。私が現在使っているスペックで、最新のGemma 4がどこまで動くのかをシミュレーションしてみました。

- OS: Windows 11

- CPU: Intel Core i9-9900K

- メモリ: 32GB

- GPU: NVIDIA RTX 2080 Super (VRAM 8GB)

結論から言うと、「日常使いなら合格、でも未来のAI体験には力不足」です。

| モデル名 | 動作判定 | 2026年現在の使い勝手 |

| Gemma 4 E2B / E4B | ◎ 快適 | ブログの推敲や、短いコード生成なら爆速です。 |

| Gemma 4 26B A4B | △ 忍耐 | 思考は深いが、喋り出しが遅い。メモリ32GBがカツカツ。 |

| Gemma 4 31B | × 厳しい | 読み込みに数分かかり、1文字出るのもやっとの状態。 |

最大の壁は、GPUの「VRAM 8GB」という容量。

AIモデルがビデオメモリに収まりきらないと、速度がガタ落ちしてしまうらしいです。

2. AIPC化への「二段構え」ロードマップ

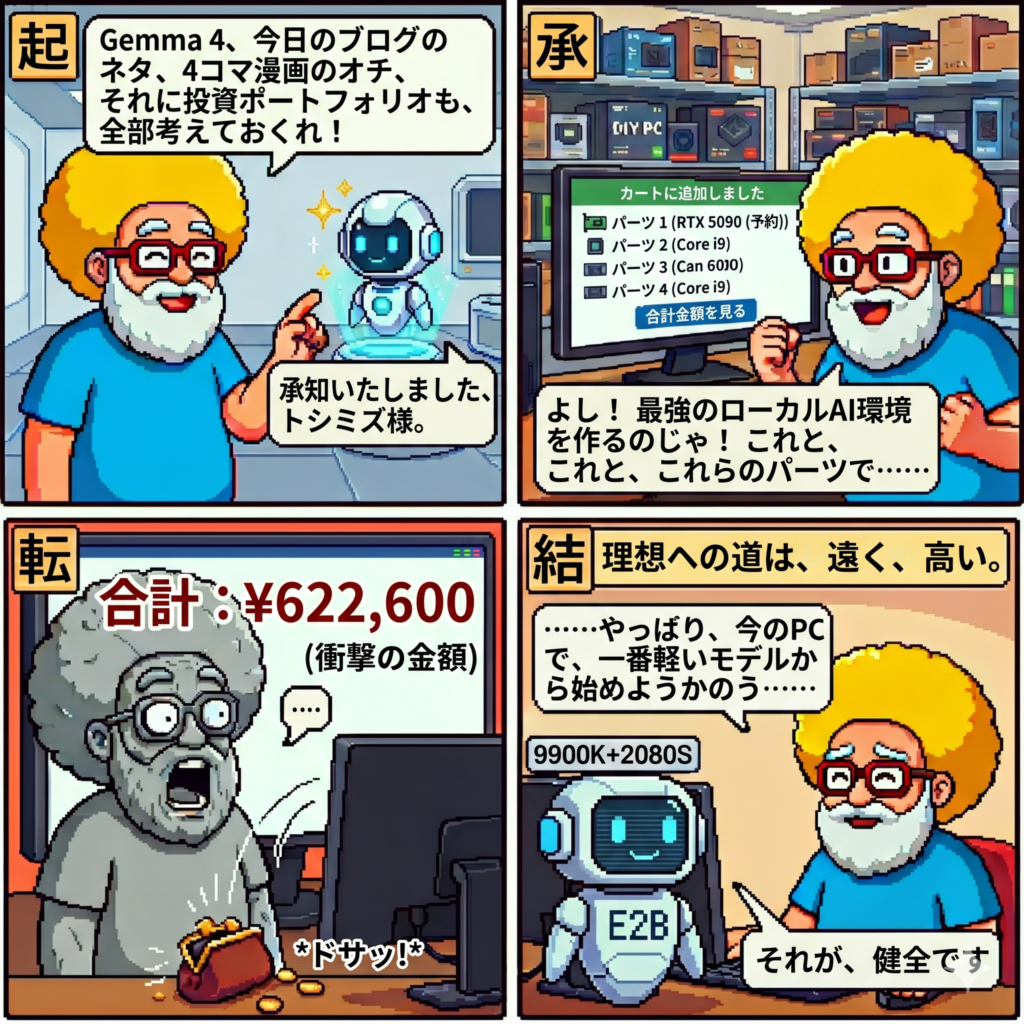

一気に60万円オーバーの出費は、さすがに私の家計(と嫁さんの視線)が持ちません。

そこで、自作派らしい「段階的な強化」を考えていきます。

【第1段階】 思考の「土台」を刷新する

まずはGPU以外のプラットフォームを入れ替えます。

- 狙い: 最新CPUが持つ「NPU」を手に入れること。

- メリット:

日常的な翻訳や文字起こしを、消費電力の少ないNPUに任せ、メインメモリを64GB以上に増設することで、巨大なAIモデルを(低速ながらも)確実に動かせる「粘り」を手に入れます。

【第2段階】 推論の「筋肉」を強化する

予算が整い次第、いよいよ本命のGPUを更新します。

- 狙い: VRAM 16GB以上の確保。

- メリット: これでGemma 4の大型モデルもサクサク動きます。4コマ漫画の生成や複雑な投資データの分析も、一瞬で終わる別世界が待っています。

3. 2026年版「AIPC」ハイエンド構成一覧

トシミズが考える、これからの5年を支える最強の構成案がこちらです。

| パーツ種別 | 推奨モデル | AIへの貢献度 | 概算予算 (税込) |

| CPU | Core Ultra 9 285K | 内蔵NPUでOSのAI機能を下支え | ¥94,000 |

| GPU | RTX 5080 (16GB) | 速度の要。16GBのVRAMは必須 | ¥252,300 |

| メモリ | DDR5-6000 64GB | モデルを広げるための巨大な作業机 | ¥110,000 |

| SSD | Gen5 NVMe 2TB | 重いモデルを数秒でロードする瞬発力 | ¥64,800 |

| その他 | マザー・電源・ケース | 最新規格への対応と安定した電力供給 | ¥101,500 |

| 合計 | 約 ¥622,600 |

トシミズ’s EYE:

「高すぎる!」という声が聞こえてきそうです(私も4コマのトシミズのように目玉が飛び出しました)。しかし、クラウドAIに月々数千円払い続ける代わりに、自分の手元に最強の知能を持つ「資産」を残す。そう考えると、あながち悪くない投資だと思いませんか?でも高くて手が出そうにない!最近のゲーミングPCの価格も50万とか60万とかの価格になってきていますが…

4. 結び:AIを「ローカル」で動かす自由

なぜ、そこまでしてローカルにこだわるのか。

それは「プライバシー」と「自由」があるからです。

自分のブログの下書き、未発表の4コマ漫画のアイデア、家族との大切な記録。

これらをクラウドに預けることなく、自分のPCの中でAIと対話しながら形にしていく。

これこそが、大人の自作PCの極致ではないかと思うのです。

さあ、皆さんのPCの「健康診断」は済みましたか?

次回はいよいよ、この新しい環境にGemma 4をインストールする実践編をお届けする予定です。

まずは、一番軽いGemma4のモデルをスマホにインストールしてみます。

お楽しみに!

最後に、ご自分のPCでどのローカルAIが動くのかがわかるサイトを見つけたので、お知らせします。こんなにたくさんローカルAIがあることにまず驚きました。

どのローカルAIを動かすことができるのかを調べてみてはどうでしょうか?

https://www.canirun.ai/?license=commercial&sort=release

MSI GeForce RTX 5080 16G VENTUS 3X

AI体験を劇的に変えるのは、計算速度よりも「VRAM容量」です 。16GBの広大なメモリがあれば、Gemma 4の大型モデルもビデオメモリ内に完結。クラウドAIに依存せず、深夜の作業でもプライバシーを守りながら、プロンプトに対して一瞬で答えが返ってくる快感を味わえます。

Crucial(クルーシャル) PRO (マイクロン製) デスクトップ用メモリ 32GB×2枚 DDR5-6400 オーバークロック

メモリを64GBに増設することは、AIという名の知的な相棒に「巨大な作業机」を与えるのと同じです 。複数のAIツールを同時に立ち上げても、ブラウザを何十個開いてもびくともしません。将来さらに巨大化するモデルへの備えとしても、今このタイミングでの「倍増」が正解です。

Acer Predator Gen5 M.2 SSD 1TB GM9 NVMe2.0 2280

Gen5 SSDを導入すれば、数GBから数十GBに及ぶAIモデルのロードは「数秒」で終わります 。PCを起動してすぐにAIとの対話を始められるスピード感は、まさにローカル環境ならではの贅沢。ストレスフリーな開発・執筆環境が、あなたの創作意欲をさらに加速させます。

⭕️その他にも

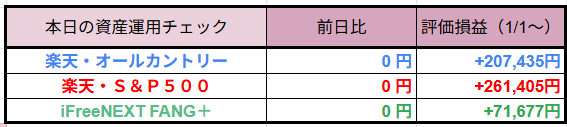

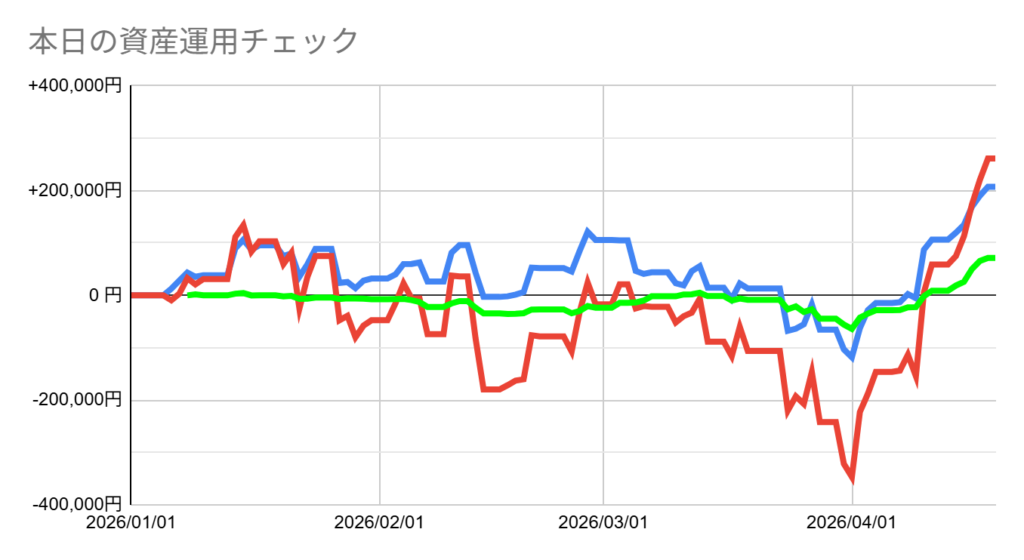

【本日の資産運用チェック】2026/04/19(日)現在

★★「またまた、上がりましたね~😀 とうとうオルカンをS&P500が追い越しました❗️中東情勢はまだ不安定な要素はあるのですが、もう一度ぐらい『稲妻の光る瞬間』をみたい‥」😆👀★★

-640x360.jpg)

-640x360.jpg)

-320x180.png)

-320x180.png)

-1-320x180.jpg)

-320x180.jpg)

-320x180.jpg)